- Liittynyt

- 14.10.2016

- Viestejä

- 25 021

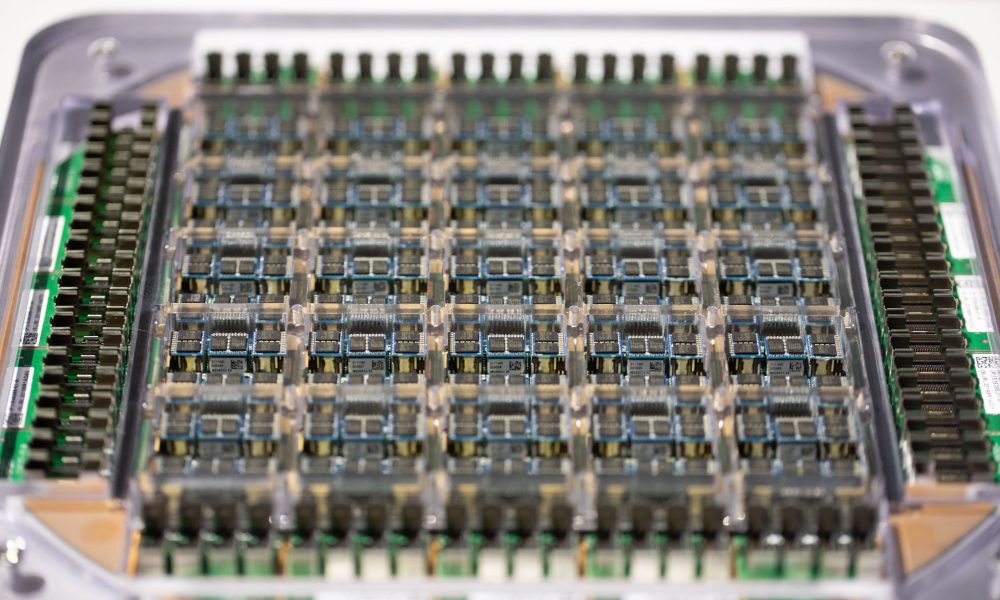

Tesla on saanut valmiiksi itse kehittämänsä AI5-piirin. AI5:n on tarkoitus pyörittää tekoälytehtäviä Teslan autoissa. AI5 on jatkoa aiemmin HW- eli Hardware-sarjana tunnetuille piireille.

Linkki: https://x.com/elonmusk/status/2044315118583066738

Elon Musk kiitti twiitissä piirin mahdollistamisesta sekä TSMC:tä että Samsungia, mikä selittyy sillä, että tiettävästi samaa piiriä tehdään kummankin valmistajan toimesta. Samsung valmistaa AI5-piirejä Texasissa ja TSMC Arizonassa. Muskin mukaan AI5-siru on noin puolet valmistusprosessin mahdollistamasta koosta (half the reticle size).

Itse AI5-piirin ohella samasta paketoinnista löytyy yhteensä 12 SK Hynixin muistipiiriä. TechPowerUpin mukaan ne olisivat LPDDR5X-piirejä, kun Tom's Hardware epäilee niiden olevan GDDR6- tai GDDR7-piirejä.

Linkki: https://x.com/elonmusk/status/2044315118583066738

Elon Musk kiitti twiitissä piirin mahdollistamisesta sekä TSMC:tä että Samsungia, mikä selittyy sillä, että tiettävästi samaa piiriä tehdään kummankin valmistajan toimesta. Samsung valmistaa AI5-piirejä Texasissa ja TSMC Arizonassa. Muskin mukaan AI5-siru on noin puolet valmistusprosessin mahdollistamasta koosta (half the reticle size).

Itse AI5-piirin ohella samasta paketoinnista löytyy yhteensä 12 SK Hynixin muistipiiriä. TechPowerUpin mukaan ne olisivat LPDDR5X-piirejä, kun Tom's Hardware epäilee niiden olevan GDDR6- tai GDDR7-piirejä.

Viimeksi muokattu: